Le vibe coding peut-il gérer les données de votre organisation ?

Le vibe coding peut-il gérer les données de votre organisation ?

Le vibe coding s'impose en 2026 comme une pratique courante dans les équipes de développement. La question que posent aujourd'hui les DSI, les CDO et les responsables data est légitime : si l'IA peut générer un script de nettoyage de données en trente secondes, à quoi sert encore une plateforme dédiée ?

Cet article y répond de façon objective — en distinguant ce que le vibe coding fait réellement bien, et les domaines où il atteint structurellement ses limites sur les données d'une organisation.

Le vibe coding en 2026 : définition et état des lieux

Le terme a été créé par Andrej Karpathy, cofondateur d'OpenAI, en février 2025. Il décrit une approche de développement où l'on décrit son intention en langage naturel et laisse l'IA générer le code — sans nécessairement le lire ligne à ligne.

Collins Dictionary l'a élu mot de l'année 2025. Google Trends enregistre une progression de +6 700 % des recherches depuis janvier 2025. Aujourd'hui, 92 % des développeurs américains utilisent des outils d'IA au quotidien, et 46 % du nouveau code mondial est généré par IA (Second Talent, 2026).

En février 2026, Karpathy lui-même a déclaré le concept "dépassé" — au profit d'une ingénierie plus structurée où l'humain supervise et valide. Malgré cela, la pratique continue de se déployer dans les organisations, souvent en dehors de tout cadre de gouvernance.

Appliqué aux données, le vibe coding se traduit par des instructions du type : "Génère un script pour nettoyer ma base clients, éliminer les doublons et normaliser les codes postaux." Le résultat arrive en trente secondes. Il fonctionne en test. Les problèmes apparaissent en production.

Ce que le vibe coding fait bien et dans quels contextes

Le vibe coding présente des avantages réels dans des contextes précis. Il serait inexact de le rejeter globalement.

L'exploration de données est son terrain de prédilection : analyser rapidement la structure d'un nouveau jeu de données, identifier des patterns, générer un rapport ponctuel sur un volume limité. Pour ces usages, la vitesse qu'il offre est un avantage concret.

Le prototypage de règles métier est un autre cas d'usage valide : tester une logique de déduplication sur un échantillon, valider une approche avant de la formaliser dans un pipeline de production.

Les projets à durée de vie courte — scripts internes sans enjeu réglementaire, automatisations ponctuelles sur données non critiques — entrent également dans cette catégorie.

En dehors de ces contextes, les limites structurelles du vibe coding deviennent des risques opérationnels.

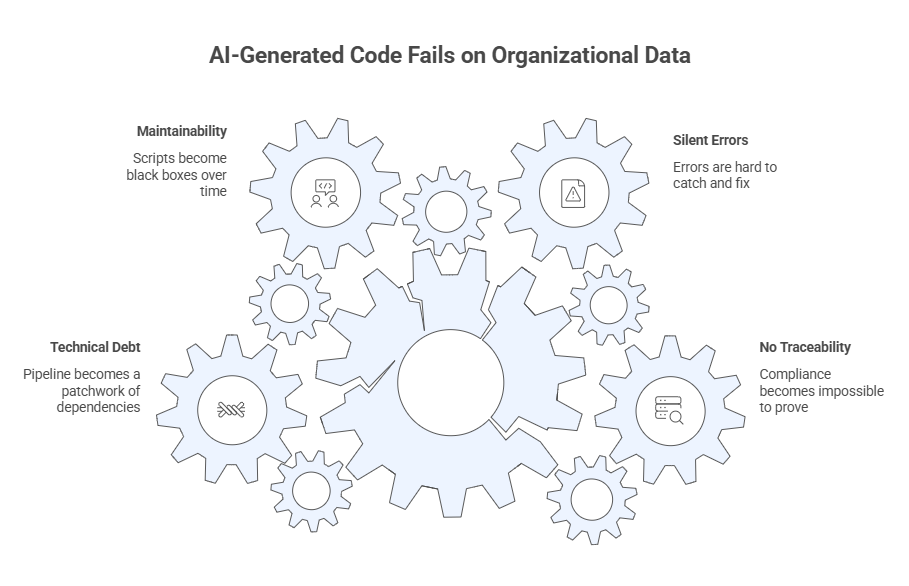

Pourquoi le vibe coding échoue sur les données en production ?

Aucune traçabilité : la conformité RGPD devient impossible à prouver

Le RGPD, BCBS 239, NIS2 et le Cyber Resilience Act imposent une traçabilité complète des traitements de données. Un script généré par IA ne documente pas ses transformations. Il ne produit pas de lineage. Il ne permet pas de prouver, lors d'un audit, que les données personnelles ont été traitées conformément aux obligations légales.

Or la responsabilité juridique de ces traitements reste entièrement à la charge de l'organisation. La CNIL et les régulateurs sectoriels ne reconnaissent pas "la génération automatique par IA" comme preuve de conformité.

Des erreurs silencieuses difficiles à détecter à grande échelle

Un modèle de langage optimise pour produire du code syntaxiquement correct — pas nécessairement du code juste sur vos données, avec vos règles métier, dans votre environnement de production.

Une règle de déduplication peut être statistiquement plausible et métier incorrecte. Une logique de normalisation peut fonctionner sur 1 000 lignes et corrompre silencieusement des millions d'enregistrements pendant des semaines avant d'être détectée.

Les données le confirment : 45 % du code généré par IA contient des vulnérabilités exploitables (Georgetown CSET). Le code IA produit 1,7 fois plus de problèmes majeurs que le code humain à la revue (CodeRabbit, 2025). Ces statistiques prennent un poids différent dès lors qu'il s'agit de données financières, clients ou RH.

Une maintenabilité limitée à l'auteur du script

Plus de 40 % des développeurs admettent déployer du code IA qu'ils ne comprennent pas entièrement (Deloitte, 2025). Quand le collaborateur qui a écrit ce code change de poste ou quitte l'organisation, les scripts deviennent des boîtes noires. Personne ne peut les modifier sans risque. Personne ne peut les expliquer à un auditeur.

Dans des organisations où les équipes data évoluent régulièrement, ce schéma génère une dette technique qui s'accumule silencieusement — jusqu'à ce qu'un incident oblige à tout reconstruire.

Une dette technique qui s'accumule sans signal d'alarme

Chaque nouvelle règle métier exige un nouveau script. Chaque script ajoute une couche de dépendance. Six mois plus tard, le pipeline est un empilement que personne ne maîtrise dans son intégralité.

Google's DORA research mesure l'impact : quand l'adoption de l'IA dans le code augmente sans gouvernance associée, la stabilité des livraisons baisse de 7,2 % en moyenne. GitClear a analysé 211 millions de lignes de code : le taux de refactoring est passé de 25 % des modifications en 2021 à moins de 10 % en 2024.

À cela s'ajoute un coût souvent sous-estimé : celui de l'itération. Quand un script vibe-codé produit des résultats incorrects en production — ce qui arrive — chaque cycle de débogage, de re-génération et de correction consomme du temps, des ressources et des appels API dont le coût s'accumule de façon imprévisible. Sur des pipelines data complexes, ces cycles peuvent être nombreux et difficiles à budgéter.

Pour une organisation qui gère des dizaines de systèmes sources et des millions d'enregistrements, cette dette se traduit concrètement par des projets BI qui produisent des résultats incohérents et des modèles IA qui hallucinent faute de données fiables en entrée.

Vibe coding ou plateforme de données : comment choisir ?

|

Situation |

Vibe coding |

Plateforme structurée |

|

Exploration d'un nouveau jeu de données |

✅ Adapté |

Surdimensionné |

|

Prototype < 10 000 lignes, sans enjeu réglementaire |

✅ Légitime |

Surdimensionné |

|

Pipeline en production sur données clients ou financières |

❌ Risque structurel |

✅ Conçu pour ça |

|

Données personnelles soumises au RGPD |

❌ Traçabilité absente |

✅ Lineage natif |

|

Audit de conformité à produire |

❌ Impossible à reconstituer |

✅ Exportable en quelques clics |

|

Règles métier maintenues par une équipe qui évolue |

❌ Dépendance à l'auteur |

✅ Pipelines lisibles par tous |

|

Alimentation de modèles IA en production |

❌ Données non certifiées |

✅ Data AI-ready |

|

Collaboration IT / métier sur les processus data |

❌ Silos inévitables |

✅ Plateforme collaborative |

|

Coût d'itération et de maintenance |

❌ Appels API, re-générations, débogage imprévisibles |

✅ Coût prévisible, pipelines stables |

La frontière n'est pas technique. Elle est organisationnelle et réglementaire : là où la donnée engage la responsabilité de l'organisation, le vibe coding n'est pas l'outil approprié.

Ce qu'apporte une plateforme de Data Intelligence comme Tale of Data

Tale of Data est une plateforme de Data Intelligence No-Code alimentée par l'IA. Elle couvre l'ensemble du cycle de vie de la donnée en cinq capacités clés.

Une vue catalogue et un module Mass Data Discovery pour accéder à l'ensemble des jeux de données et référentiels et cartographier automatiquement le patrimoine de données — bases de données, fichiers, plateformes cloud comme Snowflake ou Databricks. Le module MDD remonte pour chaque colonne le type, la nature de la donnée, les statistiques et le score de qualité. Sans cette visibilité, chaque nouveau projet data repart de zéro.

Un Flow Designer visuel No-Code pour construire des pipelines de traitement — jointures, déduplication, normalisation, enrichissement, agrégation — sans écrire une ligne de code. Chaque flow se lit comme un document. N'importe quel membre de l'équipe peut le comprendre, le modifier et le planifier. Quand un collaborateur part, le travail reste lisible et maintenable.

Un moteur de qualité et de Data Observability qui applique des règles fixes et reproductibles sur l'ensemble du patrimoine. Le module MDD surveille en continu la fraîcheur, le volume, la qualité et le schéma des données, et déclenche des alertes configurables en temps réel. Les mêmes données produisent les mêmes résultats à chaque exécution.

Des tableaux de bord intégrés construits par glisser-déposer directement dans la plateforme, pour visualiser et contrôler l'état des données sans outil externe.

Un Data Lineage natif accessible depuis le catalogue, les flows et les tableaux de bord. Chaque transformation est traçable en amont et en aval. La preuve de conformité RGPD est dans la plateforme — pas dans les emails d'un collaborateur parti.

Cas concret : Manutan et l'industrialisation de la qualité données

Manutan est le premier fournisseur européen de produits aux entreprises : plus d'un million de références produits, 17 pays, 28 filiales. La qualité de leurs données catalogue a un impact direct sur les opérations — une donnée de complétude insuffisante sur une caractéristique produit génère des retours clients, des litiges et des pertes de marge.

Le défi de Manutan n'était pas d'écrire un script. C'était d'industrialiser des processus de qualité données répétables, collaboratifs, maintenables par des équipes qui évoluent — sur un catalogue de plus d'un million de références dans 17 pays.

Avant Tale of Data, chaque cas d'usage de nettoyage ou de réconciliation était traité via des scripts Python écrits manuellement. La mise en place prenait une semaine. La transmission entre collaborateurs était complexe. Et chaque nouveau cas repartait de zéro.

"À partir de deux sources de données différentes, nous avons préparé un workflow et traité notre cas d'usage en deux heures là où il fallait une semaine auparavant en utilisant des scripts Python. Nous avons déroulé nos use cases selon plusieurs critères importants pour nous avec différentes solutions, et Tale of Data est celle qui s'est imposée."

Mbery Ngom, Data Quality Analyst, Manutan

Le gain en vitesse est réel. Mais ce n'est pas le seul enjeu. Ce workflow de deux heures est aujourd'hui lisible, modifiable et transmissible par n'importe quel membre de l'équipe — sans dépendre de son auteur, sans ré-explication, sans risque de régression. C'est ce qu'un script — généré par IA ou non — ne peut pas garantir.

Conlusion : le vibe coding peut-il gérer les données de votre organisation ?

Le vibe coding répond à un besoin réel de rapidité dans les premières phases d'un projet data. Mais la rapidité de génération ne remplace pas la gouvernance, la traçabilité et la maintenabilité que les données d'une organisation requièrent en production.

Les organisations qui confondent les deux se retrouvent, quelques mois plus tard, avec des pipelines que personne ne comprend, des audits impossibles à produire et des modèles IA qui échouent faute de données fiables en entrée.

Tale of Data combine la vitesse d'une plateforme No-Code avec la rigueur d'un moteur de qualité déterministe, d'un Data Catalog vivant et d'une traçabilité native — pour industrialiser les données sans sacrifier la conformité ni accumuler une dette technique invisible.

→ Évaluez le coût de la non-qualité de vos données avec le ROI Calculator de Tale of Data

FAQ : Data Quality tool vs Vibe Coding

Le vibe coding est adapté à l'exploration et au prototypage sur des volumes limités. Il n'est pas conçu pour gérer des données en production dans un environnement réglementé : il ne produit pas de traçabilité, ne documente pas les transformations et ne garantit pas la reproductibilité des résultats à grande échelle.

45 % du code généré par IA contient des vulnérabilités exploitables (Georgetown CSET, 2025). Sur des données personnelles, financières ou RH, ces failles peuvent passer inaperçues pendant des semaines. Sans lineage ni documentation automatique, il est impossible de prouver la conformité des traitements lors d'un audit RGPD.

Non. Un ETL gère des volumes industriels, produit un lineage complet et maintient des règles reproductibles dans le temps. Le vibe coding génère du code fonctionnel sur le moment, sans garantie de maintenabilité ni de traçabilité. Les deux outils répondent à des besoins fondamentalement différents.

La conformité RGPD exige que chaque traitement de données soit documenté, traçable et auditable. Cela implique un lineage complet, une détection automatique des données personnelles et sensibles, et des workflows de validation formalisés. Ces éléments doivent être natifs dans l'outil utilisé — pas reconstitués a posteriori.

La dette technique désigne l'accumulation de scripts non documentés, non maintenus et incompréhensibles pour les personnes qui n'en sont pas les auteurs. Google's DORA research montre qu'une adoption de l'IA dans le code sans gouvernance associée réduit la stabilité des livraisons de 7,2 % en moyenne. Sur des pipelines data critiques, cette instabilité se traduit par des rapports incohérents et des modèles IA dégradés.

Oui. Le vibe coding peut prototyper une règle ou explorer une source. Une plateforme de Data Quality industrialise, documente et gouverne ce qui passe en production. Les deux approches sont complémentaires à condition de ne pas les confondre.

You May Also Like

These Related Stories

L'IA n'améliorera pas votre qualité des données — voici ce qui le fera

Data Lineage : comprendre l'importance et les bénéfices de la traçabilité des données